- Tech

- prediktív

- előrejelzőrendfenntartás

- biddata

- adatelemzés

- predpol

- bűnmegelőzés

- előítéletek

- prediktívbűnmegelőzés

- különvélemény

Figyelünk, mert tudjuk, hogy bűnözni fogsz

További Tech cikkek

-

Az Instagram ezentúl korlátozza a politikai tartalmakat

Az Instagram ezentúl korlátozza a politikai tartalmakat - Japán szigorítana a mesterséges intelligencia fejlesztésén

- Elképesztő változáson esik át a Waze

- Fél évig akár féláron is használhatják a vezetékes internetet a Digi előfizetői

- Aggódik az Apple az iPhone miatt, biztonsági kockázatokat rejthet egy uniós szabályozás

Ha a prediktív vagy előrejelző rendfenntartás (angolul predictive policing) szóba kerül, a legtöbbünknek a Különvélemény juthat eszébe, amelyben Tom Cruise már a gyilkos előtt tudja, hogy ő lesz az elkövető, és már a börtön felé tessékelik a gondolatbűnöst, mielőtt megtörténne a bűntett. De nemcsak mi gondolunk a virtuális képernyőket dobáló Cruise-ra, a már a valóságban működő rendszerek egyik legnépszerűbbikének, a PredPolnak az atyja is így védte meg a szoftverét a kritikától:

Ez nem a Különvélemény. Az arról szól, hogy megjósolják, ki fog bűnözni, mielőtt megtenné. Mi azt jósoljuk meg, hol és mikor a legvalószínűbb, hogy bűntény történik, nem azt, hogy ki követi el.

Bár olyan megoldást is tesztelnek már, amely közelebb áll a sci-fihez, az tény, hogy a 2002-es filmtől még messze vagyunk. A valóságban a prediktív rendfenntartás nagyjából annyit jelent, hogy nagy adatmennyiséget felhasználva, számítógépes elemzéssel, közel valós időben határozzák meg, hova vagy kire érdemes a rendőrség erőforrásait összpontosítani. Nem jóslásról van szó, csak valószínűségszámításról és kockázatelemzésről. Nem jövőbeli képek, hanem múltbeli adatok alapján működik. Nem látnokok, hanem algoritmusok segítik a rendőrök munkáját. Inkább az időjárás-előrejelzéshez hasonlít, vagy ahhoz, ahogy egy járvány terjedési mintázatát térképezik fel. Unalmasabban hangzik, mint a film, ugye? Pedig nem sokkal kevésbé kockázatos.

Forró pontok és elrettentő erő

A prediktív módszerek összefüggéseket tárnak fel, amelyek alapján bizonyos helyek nagyobb eséllyel válnak bűntett helyszínévé, vagy bizonyos emberek valószínűbben követnek el bűntényt. A rendőrségi adatelemzés, a trendek figyelése persze messze nem új dolog.

Ahhoz például még nem kell profi adatelemzőnek lenni, hogy megnézzük kerületekre lebontott bűnözési statisztikákat, vagy hogy tudjuk, hogy az üzletekbe éjszaka, az otthonokba nappal törnek be nagyobb eséllyel. A dolog onnantól lesz érdekes, amikor nem ilyen alapvető, és főleg nem ilyen kevés adatból próbálunk meg következtetni, hanem akár sok ezer tényezőt próbálunk meg figyelembe venni.

A prediktív rendfenntartás valójában csak a következő lépés egy néhány évtizede tartó evolúcióban

– mondta Jeff Brantingham, a PredPol már idézett fejlesztője.

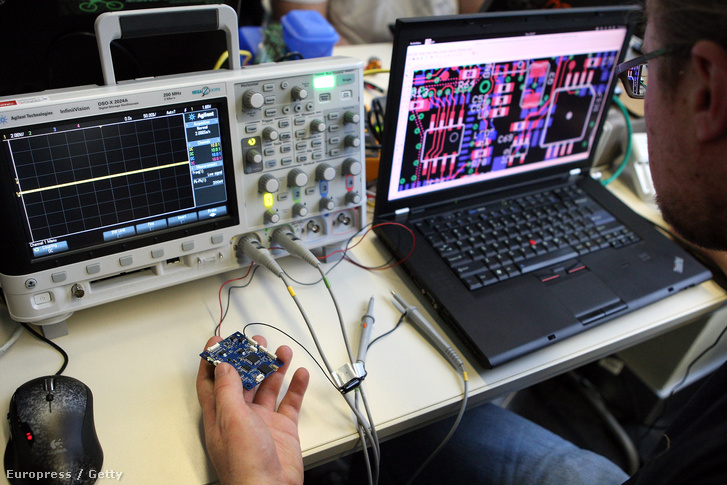

A terület egyik úttörője a memphisi rendőrség, náluk már 2005-ben beindítottak egy kísérleti programot Blue CRUSH néven. De igazán néhány évvel később robbant be az előrejelzés-ipar. Amerikában országszerte számos nagyvárosban indultak kísérleti programokat, részben azért, mert az igazságügyi minisztérium óriási támogatást hirdetett meg ezekre 2009-ben. Ennek is köszönhető, hogy Chicagótól Miamiig, Los Angelestől New Yorkig megjelentek a rendőrségi központokban az adatelemző algoritmusok és az interaktív térképek.

A legnépszerűbb és legelterjedtebb rendszert a beszédes nevű PredPol kínálja. Ez a helyszínekre koncentrál, úgynevezett hotspotokat határoz meg, ahová érdemes több rendőrt irányítani, hogy akár a puszta jelenlétük elvegye a potenciális elkövetők kedvét. Mindezt valós időben, interaktív térképen kínálja, folyamatosan vándoroló hotspotokkal.

A mindössze 150 négyzetméteres hotspotok kijelöléséhez háromféle adatot használ a rendszer: milyen típusú bűntények történtek korábban, hol történtek, és mikor történtek. Kényesen figyelnek arra a cégnél, hogy semmilyen személyes adatot ne használjanak, direkt nem foglalkoznak magukkal az esetleges elkövetőkkel.

Az ilyen helyalapú előrejelzéseket nem csak erőszakkal kapcsolatos esetekben lehet használni, Chicagóban például hasonló rendszer alapján ellenőrzik az éttermeket is. Írtak egy algoritmust, amely nyilvános városi adatok átfésülése alapján rangsorolta a helyeket, hogy melyeknél valószínűbb valamilyen élelmiszer-biztonsági előírás megszegése. Továbbra is ellenőriznek minden helyet, de ennek a listának az alapján mennek sorba. Mióta ez a rendszer működik, vagyis 2015 eleje óta, több mint egy héttel korábban sikerül azonosítani a szabálytalanságokat, így hatékonyabbá vált az ételmérgezések megelőzése.

Ehhez a korábbi szabálysértéseken kívül figyelembe vesznek olyan tényezőket is, mint az étterem környékéről érkező közegészségügyi panaszok, közeli betörések, vagy hogy milyen az utóbbi napok átlaghőmérséklete. A kód egyébként szabadon elérhető, bármelyik város átvehetné a rendszert, ha van hozzá elég adata.

Mutasd az adataid, megmondom, ki vagy

A helyszínalapú előrejelzés azonban csak a kezdet. Angliában is folynak kísérletek, Londonban például 2014-ben tesztelték az Accenture nevű cég rendszerét. Ez már nem helyekre, hanem potenciális elkövetőkre koncentrált.

De a nagy techcégek se akarnak kimaradni. A tekintélyes bigdata-elemző múlttal büszkélkedő IBM például szintén több amerikai nagyváros rendőrségével dolgozik együtt. Ők a térképes előrejelzéseken túllépve, különböző adatbázisok összekapcsolásával keresnek szabad szemmel nehezen észrevehető kapcsolatokat emberek, helyek és eszközök (autók, telefonok, stb) között. Bűnügyi adatokon túl felügyeleti kamerák képeit vagy éppen Facebook-bejegyzéseket is felhasználnak. Mark Ploszay, a cég specialistája szerint az adatvizualizációs rendszerük fél perc alatt elvégzi azt a munkát, ami az elemzőknek három napig tartana. Erről Ploszay bővebben a korábbi interjúnkban beszél, ezt ide kattintva olvashatják.

A Microsoft is már 2012 óta dolgozik a PredPoléhoz hasonló szoftveren, de ők is tovább mennének ennél. Tavaly olyan programot kezdtek fejleszteni, amely megmondja, melyik rab fog a szabadulásától számított hat hónapon belül újra börtönbe kerülni. Olyan adatokat vesz figyelembe, mint hogy az illető tagja-e valamilyen bandának, részt vesz-e elvonón, a börtönben mennyi szabálysértést követett el, hány óra elzárást kapott, és hasonlók. A cég szerint az algoritmusuk 91 százalékos pontossággal működik.

De innen már tényleg csak a képzelet és a közfelháborodás szabhat határt a lehetőségeknek. 2013-ban például Jim Adler, egy háttérellenőrzéssel foglalkozó cég munkatársa írt egy algoritmust, amely a cég adatbázisa alapján határozta meg, hogy ki fog valószínűsíthetően bűncselekményt elkövetni. Ehhez olyan adatokat is felhasznált, mint a nem, szemszín, bőrszín, vagy hogy van-e tetoválása az illetőnek.

Ez veszélyes terület, ahol az álpozitív találatok egy zsarnoki kormány visszaéléseihez vezethetnek az ártatlanokkal szemben. Viszont azzal kecsegtet, hogy segíthet elkapni olyanokat, mint Snowden, a bostoni merénylők vagy a Newtownt és Aurorát megtámadó tömeggyilkosok

– mondta Adler, és ezzel akaratlanul arra a problémára is rávilágított, hogy nemcsak az a kérdés, hogy ki követhet el bűnt, hanem az is, hogy ki mondja meg, mi a bűn. Jobban járt volna-e vajon a társadalom, ha Edward Snowden NSA-s szivárogtatása idején elérhető egy ilyen technológia, és Snowdent még azelőtt letartóztatják, hogy az első emailt elküldi a tömeges titkosszolgálati adatgyűjtésekről?

Azok a mocskos adatok

A módszer bizonyossága tehát csak sci-fi, a valódi előrejelzés minősége nagyban függ a kiindulópontként szolgáló adatok minőségétől – kezdve olyan anomáliákkal, mint az elírások, a beviteli hibák, a különböző adatbázisokból származó adatok összekötése, a hasonló, de valójában másra vonatkozó adatok szétválasztása, a kvantitatív adatok feldolgozásának nehézsége vagy a direkt rosszul megadott adatok. Ezektől az adatokat meg kell tisztítani.

A kapcsolati háló és maga a büntetett előéletűség figyelembe vétele is torz statisztikákat szülhet. Amerikában például súlyos problémát jelentenek a túlzásba vitt börtönbüntetések. Amerika a bebörtönzések globális nagyhatalma, a lecsukottak aránya a népességhez viszonyítva sokszorosa bármelyik másik országénak, és a számok éppen az utóbbi évtizedekben szaladtak meg. Ha ezekre a statisztikákra alapoznak, az előrejelző rendszerek tovább gerjeszthetik ezt a trendet.

Hasonló kérdéseket vet fel a személyes adatok kezelése is. A PredPol például épp azért kerüli ezek használatát, hogy távol tartsa magától a személyes profilalkotás vádját, de a kiterjedtebb rendszerek nem ilyen finnyásak. Ez a helyzet hasonló ahhoz, amikor az FBI panaszkodik, hogy nem kap elég adatot a terrorizmus elleni harchoz. A kérdés itt az, hogy

Ez a dilemma felidézi New York ellentmondásos, “megállít és átkutat” ( stop-and-frisk) nevű gyakorlatát is. Eszerint a rendőrök megállíthatnak és átkutathatnak bárkit, aki szerintük gyanús. Az így megállítottak száma 2011-ben elérte a 684 ezret, de 88 százalékuk ártatlannak bizonyult. Ráadásul a gyakorlatot túlnyomó többségében feketék és latinók ellen alkalmazták. De hát éppen az ilyen elfogultságot és túlkapásokat szűrhetné ki rideg objektivitással a szoftveres megoldás, legalábbis elvileg.

Öröklődő előítéletek

Néhány szakértő szerint az ilyen adatelemző, térképes szoftverek legtöbbször semmi olyat nem mondanak, amit a helyi rendőrségi elemzők ne tudnának – ahol gyakori a bűnözés, ott nagyobb valószínűséggel lesz bűntény –, csak új formába csomagolja a következtetéseket. Szerintük a kizárólag gépi adatelemzésen nyugvó módszer valódi ígérete az lenne, hogy kiszűri az emberi előítéleteket a rendőrségi gyakorlatból. Ezzel megszűnhetne például a gyanúsítottak etnikai alapú kiválogatása.

A gond az, hogy ez akkor valósulhatna meg, ha az elemzendő adatok is tiszták lennének. A valós helyzet azonban inkább úgy néz ki, hogy az összegyűjtött adatok már eleve elfogultak lehetnek, márpedig az algoritmusok is csak abból tudnak főzni, amijük van. Például arányaiban több fehér árul és használ drogot Amerikában, mégis több feketét ítélnek el ilyen okokból. Így hiába rajzol szép interaktív térképet a szoftver az ilyen típusú bűntényekről, az adatokat, amelyekből dolgozik, emberi tevékenység generálta, ezért

Ha ez elérendő kvótákkal párosul, az eredménykényszer még inkább torzíthatja a statisztikákat, és végképp illúzióvá válik a semleges adat. Az olyan bűnözési típusok is alapból kiesnek vagy torzulnak, amelyeket csak kis arányban jelentenek be (például szexuális erőszak), így a már egyébként is jobban szem előtt levő tevékenységek kapnak még nagyobb figyelmet. Cathy O'Neil, a big data előítéleteket felerősítő hatásáról könyvet író matematikus szerint ez a jelenség az objektivitás délibábja.

A már említett tömeges is bebörtönzések aránytalanul sújtanak kisebbségi csoportokat. Egy fekete férfinak pedig 21-szer nagyobb esélye van arra, hogy lelövi egy rendőr, mint egy fehér férfinak, és 281 százalékkal valószínűbb, hogy jogosnak ítél a bíróság egy emberölést, ha az elkövető fehér, az áldozat pedig fekete. A szülők bebörtönzése miatt az ezekhez a csoportokhoz tartozó gyerekek is eleve hátrányból indulnak, így az előrejelzésekben is potenciális elkövetőként akadnak fenn a hálón – ami lehet, hogy tűpontos előrejelzés, csak éppen nem a rendőrségi akció fogja ezeket a rendszerszintű problémákat megoldani, még ha még oly jól informált is. Erre a közösséget bevonó, a rendőrségi akciókat kiváltó vagy megelőző, a kockázatosnak ítélt csoportokkal célzottan foglalkozó kezdeményezések célravezetőbbnek tűnnek.

Ezért mondják az adatalapú bűnmegelőzés kritikusai, hogy a veszélyes területek kijelölése a gyakorlatban ugyanúgy ráerősít a meglévő problémákra, mint ahogy a Facebook üzenőfalát összeállító algoritmus zárja buborékba a felhasználókat, amikor ugyanolyan tartalmakat ajánl nekik, amiket amúgy is kedvelnek, így egyre inkább kiszűri az ettől eltérő nézeteket.

Az algoritmus zsarnoksága

Valószínűség alapján persze még ma se lehet senkit elítélni, de kérdés, hogy a “valószínű elkövető” címkét mennyire könnyedén osztogathatják a hatóságok. A támogatók szerint nagyon is, hiszen ha tudja az illető, hogy figyelik, majd rendesen viselkedik. A kritikusok szerint viszont hiába pontos a jóslat statisztikailag, nem lehet azzal odaállni valaki elé, hogy

Chicagóban például létrehoztak egy nagyjából négyszáz fős listát a legvalószínűbb bűnelkövetőkkel – köztük még soha semmilyen szabálysértést el nem követő fiatalokkal –, akikhez bekopogott a rendőrség, hogy vigyázzanak magukra, mert rajtuk tartják a szemüket. De akad arra is példa, hogy valakit őrizetbe is vettek, még mielőtt bármit elkövetett volna, csak mert a szoftver szerint bűnelkövetés volt várható ott, ahol éppen tartózkodott.

Gary T. Marx, az MIT szociológusa szerint ez a “kategorikus gyanú” veszélyes lehet, mert ha túlságosan erre támaszkodik a rendőrség, az az algoritmus zsarnokságát hozhatja el. Ilyenkor a hatóságok könnyen figyelmen kívül hagyhatják azokat a társadalmi, gazdasági és kulturális tényezőket, amelyek a bűnözés mögött állnak.

Épp ezeket a tényezőket próbálja szem előtt tartani egy másik előrejelző módszer, az Atlantic Cityben tavaly október óta tesztelt kockázati terepmodellezés ( Risk Terrain Modeling, RTM). Ez is területeket jelöl ki, de ahelyett, hogy a konkrét bűnesetekre koncentrálna, azt próbálja megállapítani, hogy egyes helyeken miért sok a bűntény, és hogy a rendőrség hogyan tudná ezeket az okokat felszámolni, a helyszínek megváltoztatásával.

Hova vezet

Abban elméletben a jogvédők és a rendőrök is egyetértenek, hogy a rendőri munkát nem válthatja ki teljesen a szoftveres. Ott viszont már nehezebb világos határt húzni, hogy mégis mennyi automatizmus fér bele a képletbe. Az például elég ijesztően hangzik, hogy az ítélet súlyosságát is befolyásolhatja, hogy milyen valószínűséggel követne el valaki későbbi bűnöket – pedig ilyen rendszert is tesztelnek már.

A kételyek és aggályok ellenére sok amerikai nagyváros rendőrsége állítja, hogy sokat segítenek nekik a kapitányságokra beköltözött adatelemző algoritmusok, és több tesztidőszak zárult egyes bűntípusoknál látványos csökkenéssel – bár ezeknek a statisztikáknak a hitelességével, illetve a programok hosszú távú sikerével kapcsolatban is sokan szkeptikusak, egy több várost érintő, független felmérés pedig nem talált számottevő csökkenést.

Az azonban ezzel együtt is világos, hogy nagyon ígéretes lehetőségről van szó. A kérdés csak az, hogy az egyre nagyobb adatmennyiséget megmozgató előrejelző rendszerek milyen minőségű adatokkal dolgoznak, mennyire bízunk az elemzés objektivitásában, és mihez kezdenek az eredménnyel maguk a rendőrök. Vagyis hogy hova vezet a big datával kikövezett út.