További Net cikkek

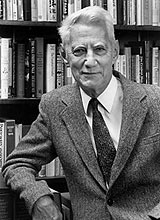

Shannon a kommunikációs rendszerek elemeit, a közöttük lévő kapcsolatokat vizsgálta. Noha munkája túlmutat a mérnöki tudományokon, elsődlegesen praktikus célokat szolgált, például azt, hogy a telefonvonalak kevésbé legyenek zajosak. Elmélete szerint a kommunikáció jelentéstani aspektusai irrelevánsak a tervező szemszögéből nézve: az üzenet statisztikai jellemzői, és nem a tartalma a meghatározó.

|

| Claude Elwood Shannon |

A legfőbb probléma, hogy egy adott ponton hibátlanul vagy megközelítőleg, reprodukáljunk egy másik pontról küldött üzenetet. Másrészt, a tényleges csak egy a lehetséges üzenetek közül. A rendszert úgy kell megtervezni, hogy ne kizárólag a kiválasztott, hanem a potenciális üzeneteket is kezelje.

A kommunikáció folyamata: az üzenet jelképekbe (szavakba, ikonokba, bitekbe, stb.) kódolása, továbbítása, dekódolása. Az üzenet információelméleti megfelelője a jel, mely (a továbbítási) csatornán keresztül jut el a (statisztikus módon üzenetet generáló) forrástól a rendeltetési helyig. Fontos tényező a csatorna sávszélessége, illetve zajtelítettsége. Az eredeti üzenetet megváltoztató zaj az információ ellentéte. (A fogadó a hasznos információra, a jelre, és nem a haszontalan információként definiált zajra kíváncsi.) A csatorna kapacitását az határozza meg, hogy az információ, a lehető legkisebb hibaszázalékkal, milyen gyorsan jut el a címzetthez. A tervezett (szimbólumráta) és a valós kapacitás soha nem azonos, például a 128000 bit/sec sebességre méretezett a másodpercenkénti 67840 bitet egyetlen esetben sem haladja meg. Tehát az outputon kimenő és az inputon bemenő (bit-szekvenciákba kódolt) jel nem lehet azonos. Ha az lenne, akkor a csatornát zajtalannak tekinthetnénk. A zaj csökkentése végett a jelet többször megismételhetjük, ezzel viszont nemcsak a hibalehetőség, hanem az információ tényleges transzmissziós rátája is csökken. Hibakorrigáló kódokat szintén használhatunk: minél kisebb az óhajtott hibavalószínűség, annál komplexebb eszközöket kell terveznünk.

|

A termodinamika második törvénye a világegyetemben állandóan növekvő rendezetlenségre, az entrópiára vonatkozik. Shannon, az entrópiát az információval azonosítva, a szónak új, az eredetivel ellentétes jelentést adott. Az entrópia növekedése az információ növekedését eredményezi. Ha összekapcsoljuk a két elméletet, arra a következtetésre jutunk, hogy egy bitnyi információ továbbításához meghatározott mennyiségű energia szükséges.

Információ-értelmezések

Shannon kortársa, Donald MacKay, brit kutató nem értett egyet az információ jelentéstani környezetből történő kiemelésével, mint ahogy a jel / zaj ellentétpárt is elvetette. Dinamikusabb modellt vázolt fel: az információ nem egy fix pontra, hanem egy, a kontextussal együtt permanensen változó értéksorra irányul.

Norbert Wiener elvetette az információnak az entrópiával történő azonosítását - a kettőt egymás ellentéteként definiálta.

A telefonokra és a számítógépekre kitalált elméletet később más területeken is alkalmazták. Az anyagi valóságától megfosztott, absztrakt információ számos, főként posztmodern filozófiai diskurzus központi tétele lett. Koncepcióvá gyúrták; Shannon eredeti elképzelésével ellentétben, a rendszer szemszögéből nem releváns fogadói kulturális közeget beemelték az elméletbe. E ponton lépünk át a virtualitásba, virtuális testek és infomorfok terébe - állapította meg N. Katherine Hayles: "Az elmélet az információt, Hans Moravec magát az elméletet teszi környezet-függetlenné." Úgy, hogy közben az általa - és mindannyiunk által használt - kommunikációs csatornák Shannon teóriája alapján működnek...