Gépi fordítás statisztikai módszerekkel

További Tudomány cikkek

-

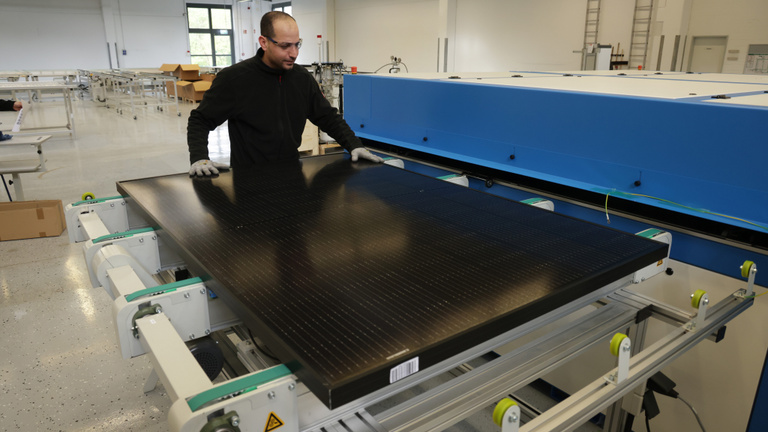

Magyar fejlesztés forradalmasíthatja a napelemparkok telepítését

Magyar fejlesztés forradalmasíthatja a napelemparkok telepítését - Eddig ismeretlen fajokat és hegyeket is találtak a víz alatt és a víz fölött is

- Van, aki még a szekrény hátuljában árválkodó bögrét is megsajnálja

- Olyan meleg az összes óceán, hogy kifehérednek a korallok

- Kiderült az igazság a Pfizer- és Moderna-vakcinákról

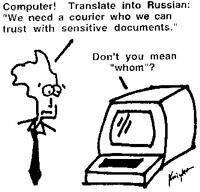

A szimbolikus és a statisztikai módszer

|

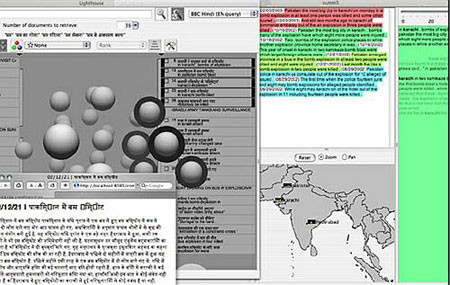

Az IBM Watson Kutatóközpontjában, Peter F. Brown és kollégái azonban már a kései nyolcvanas, korai kilencvenes évek óta egy másik eljárással kísérleteznek. Angol szöveget és különböző fordításait tanulmányozva, a számítógép statisztikai elemzést végez, így próbálja elsajátítani, megtanulni a második nyelvet. Például, kap két arab szóösszetételt: rajl kabir, rajl tawil. Ha tudja, hogy az első "nagy embert", a második "magas embert" jelent, a kettőt összehasonlítva kikövetkezteti: a rajl jelentése "ember". Az ilyen jellegű, N-grams kifejezések képezik a statisztikai gépi fordítás alapjait. (N az adott kifejezésen belüli szavak, terminusok számát jelöli.) Tehát a gépet nem a programozó oktatja, hanem saját tapasztalataiból tanul. És idővel a legkülönlegesebb nyelveket is olyan gyorsan elsajátíthatja, amit korábban elképzelhetetlennek tartottak.

A módszer gazdaságosnak tűnt ugyan, ám - komplexitása miatt - a kilencvenes évek hardvereinél, szoftverjeinél komolyabb kapacitást igényelt.

Fordítórendszerek

Fordulatot az 1999 nyarán, a Johns Hopkins Egyetemen rendezett munkaértekezlet hozott. Az ISI gépifordítás-kutatásait vezető Kevin Knight nagyszabású terveket körvonalazott. Mivel a hardver-fejlődés lehetővé tette addigra, úgy gondolta, a megfelelő program létrehozásának is eljött az ideje.

|

Hamarosan (még szintén 1999-ben) megjelent az Egypt/Giza szoftvercsomag, miközben David Yarowsky és csoportja (JH Egyetem) a legegzotikusabb nyelvek fordítására vonatkozó fejlesztésekbe fogtak: bengáli, nepáli, üzbég, sőt, a Star Trek kezdetben ellenséges, idővel barátságos klingonjaira szintén gondoltak. A Klingon Nyelvintézet a Hamletet és a Bibliát már lefordította, és a fordítások alapján létrehozott szótárféleségre támaszkodva, sokkal könnyebben boldogulnak más szövegekkel. Yarowsky azt ígéri, hogy öt éven belül száz nyelv gépifordítás-rendszerét dolgozzák ki.

|

| Franz Josef Och |

"Adjanak elegendő mennyiségű párhuzamos adatot, és napokon, sőt, órákon belül bármely két nyelvre érvényes fordítórendszerük lesz" - nyilatkozta. Statisztikai modelljei mindig az adott input legvalószínűbb megoldására találnak rá. Och nem mondja meg a számítógépnek, miként dolgozzon, hanem hagyja, hogy a modell paramétereit felhasználva, magától jöjjön rá az ideális angol, stb. szövegre. Nyelvtani, lexikológiai szabályokkal kevésbé törődik, valószínűségi-statisztikai alapokon keres helyettük pattern-párosításokat. A fordítás során a szavak helyett szócsoportokra (kifejezésekre, mondatokra) tolódott át a hangsúly.

Fordítás vagy ferdítés?

A végeredmény hagy még kívánnivalókat maga után: az olvasó ugyan érti az eredeti szöveg jelentését, nyelvtanilag azonban bőven akadnak hibák. Knight elismeri: távolról sem tökéletes a statisztikai módszer, és a maximális pontosságot megcélozva, a hagyományos és az új megközelítés kombinációjára törekszenek jelenleg. És arra is, hogy a szövegrészek jelentésének viszonylag precíz visszaadása mellett, a mondattanban se legyenek ordító esetlenségek.

Közben az IBM kifejlesztette Bleu Metric-jét, a gépi fordításokat emberi fordításon nyugvó szabvánnyal statisztikailag összevető technikát. Gyors, objektív megfigyelései segítenek a félresikerült kísérletek kiszűrésében.

Ám hiába a látványos eredmények, a statisztikai módszerről több kutató vélekedik szkeptikusan, s helyette inkább nyelv-specifikus eljárásokra összpontosítanak.