Az Európai Bizottság korlátozná a mesterséges intelligencia használatát

További Tech-Tudomány cikkek

-

AI-forradalmat ígérhetnek az Apple új M-szériás chipjei

AI-forradalmat ígérhetnek az Apple új M-szériás chipjei - Felfedezték az első természetes fraktálalkotó molekulát

- A virtuális valóság segíthet a kényszeres gyűjtögetőkön

- Bűncselekmény lesz a deepfake pornográfia az Egyesült Királyságban

- Ömlenek a milliárdok a szaúdi csodavárosba, mégis csúszik az építkezés

Szigorú szabályok vonatkoznának a magas kockázatú mesterséges intelligenciáknak nevezett rendszerekre egy a BBC birtokába került és az Európai Bizottság elé kerülő javaslat szerint, amely érintené a rendőrség által használt és a munkaerő-kiválasztásnál alkalmazott algoritmusokat is.

Homályosak, tele kiskapukkal

A BBC által megszólaltatott szakértők szerint a szabályok homályosak, és kiskapukat is tartalmaznak. A tervezet nem foglalkozik például a mesterséges intelligencia katonai felhasználásával vagy a hatóságok által „a közbiztonság védelme érdekében” használt rendszerekkel sem.

A tervezet által tiltott MI-rendszerek javasolt listájában a következők találhatók:

- Általános megfigyeléshez használt MI-rendszerek;

- Társadalmi pontozáshoz használt MI-rendszerek;

- Azok az MI-rendszerek, amelyek információkat vagy „jóslatokat” használnak ki, valamint egy személy vagy személyek csoportja ellen használják őket azért, hogy kihasználják azok gyenge pontjait.

Daniel Leufer európai szakpolitikai elemző arról tweetelt, hogy ezek a definíciók túlságosan általánosak.

Hogyan állapíthatjuk meg, hogy mi a káros valaki számára? És ki értékeli ezt?

– írta a politikus tweetjében.

Leufer szerint a

magas kockázatúnak vélt mesterséges intelligencia

ellenőrzése érdekében a tagállamoknak sokkal nagyobb felügyeletet kellene alkalmazniuk, ideértve az értékelési szervek kijelölésének szükségességét e rendszerek tesztelésére, tanúsítására és ellenőrzésére.

Továbbá minden olyan cég, amely tiltott szolgáltatásokat fejleszt, vagy ezekről nem nyújt be megfelelő információkat, a globális bevételének akár 4 százalékáig is kiszabható bírságokkal számolhatna – hasonlóan a GDPR megsértéséért kiszabott bírságokhoz.

Az MI magas kockázatú példái Leufer szerint a következők:

- Olyan rendszerek, amelyek elsőbbséget élveznek a sürgősségi szolgálatokhoz kapcsolódó diszpécserrendszerekben;

- Olyan rendszerek, amelyek szabályozzák az oktatási intézményekhez való hozzáférést vagy az emberek beosztását;

- Munkaerő-kiválasztási algoritmusok;

- Hitelképességet értékelő algoritmusok;

- Egyének kockázatértékeléséhez használt algoritmusok;

- Bűncselekmény-előrejelző algoritmusok.

Leufer azt is hozzátette, hogy a javaslatokat „ki kell terjeszteni a közszféra összes mesterségesintelligencia-rendszerére, függetlenül a hozzárendelt kockázati szinttől”, megjegyezve még:

Ennek az az oka, hogy az embereknek általában nem dönthetnek arról, hogy interakcióba lépnek-e egy mesterségesintelligencia-rendszerrel a közszférában.

Amellett, hogy az Európai Bizottság megköveteli, hogy az új mesterségesintelligencia-rendszerek emberi felügyelet alatt álljanak, a szervezet azt is javasolja, hogy a magas kockázatú mesterségesintelligencia-rendszerekbe legyen beépítve egy úgynevezett „kill switch” (rendszert azonnal leállító kapcsoló). Ez lehet ténylegesen egy stop gomb vagy valamilyen más mód a rendszer azonnali kikapcsolására, ha az szükséges.

A mesterségesintelligencia-gyártók rendkívül nagy hangsúlyt fektetnek ezekre a javaslatokra, mivel alapvető változásra lesz szükség az MI tervezésében

– állítja Herbert Swaniker, a londoni központú Clifford Chance ügyvédi iroda ügyvédje.

„Elég volt a manipulációból”

Eközben Michael Veale, aki a University College London oktatójaként digitális jogokat tanít, és azok szabályozását, kiemelt egy olyan záradékot, amely arra kényszeríti a szervezeteket, hogy közleményben jelezzék, amikor deep fake technológiát alkalmaznak, amely az MI különösen ellentmondásos felhasználása hamis emberek létrehozására vagy valós emberek képeinek és videóinak manipulálására.

Veale azt is elmondta, hogy a jogszabályok elsősorban

az olyan informatikai cégeket és tanácsadókat célozták meg, amelyek gyakran „teljesen értelmetlen felhasználásra” adnak el MI-technológiát iskoláknak, kórházaknak, rendőröknek és munkáltatóknak.

De hozzátette, hogy azoknak a technológiai cégeknek, amelyek az MI-t „a felhasználók manipulálására” használták, szintén meg kell változtatniuk a gyakorlatukat.

Kötéltáncot jár az Európai Bizottság

Ezzel a jogszabálytervezettel az Európai Bizottság nagyon veszélyes kötéltáncot jár, hiszen egyrészről biztosítania kell, hogy a mesterséges intelligencia tényleg olyan „eszköz” legyen, amelyet „csakis az emberi jólét és jó közérzet érdekében” alkalmaznak, de közben

mégse korlátozza az EU versenyképességét az Egyesült Államok és Kína technológiai újításaival szemben.

Emellett pedig a tervezet is elismerte, hogy az MI már az életünk számos aspektusának szerves része.

A Magyarországon is működő Európai Nonprofit Jogi Központ, amely hozzájárult az Európai Bizottság mesterséges intelligenciáról szóló „fehér könyvének” elkészítéséhez, szintén azt nyilatkozta, hogy a törvényjavaslatban „túl sok a homályos pont és a kiskapu”.

A magas és az alacsony kockázat bináris meghatározását célzó uniós megközelítés a legjobb esetben csak hanyag, rosszabb esetben veszélyes is, mivel hiányzik a kontextus, és hiányoznak az árnyalatok a komplex mesterségesintelligencia-ökoszisztéma számára, amely ma már létezik.

Először is a bizottságnak jogalapú keretek között kell mérlegelnie az MI-rendszerek kockázatát – mint olyan kockázatokat, amelyeket az emberi jogokra, a jogállamiságra és a demokráciára jelentenek.

Másodszor, a bizottságnak el kell utasítania a túlságosan leegyszerűsített alacsony-magas kockázatú struktúrát, és fontolóra kell vennie egy „szintalapú megközelítést” az MI kockázatának felmérése terén

– olvashatjuk az elemzésükben.

Ez a sok ellentmondás is azt vetíti elő, hogy a részletek még finomodnak, mielőtt a törvénytervezetet jövő héten hivatalosan is nyilvánosságra hozzák. Az irányelv bevezetése pedig évekig tartó folyamat.

(BBC)

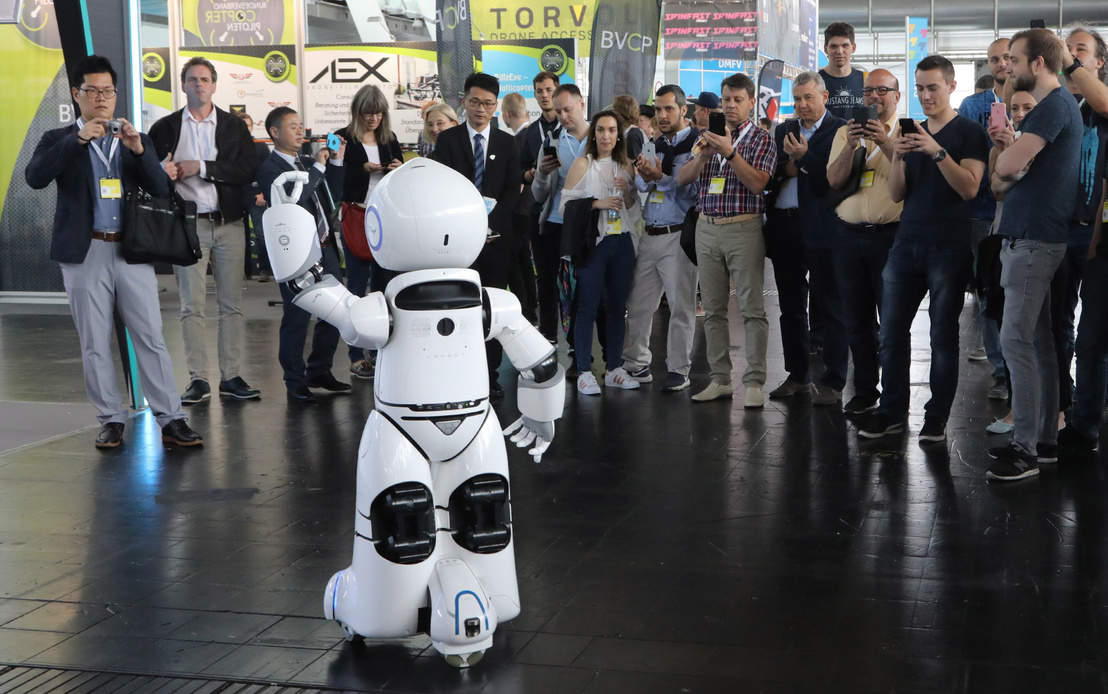

(Borítókép: Látogatók egy táncoló robotot néznek Európa legnagyobb digitalizációs és innovációs üzleti fesztiválján, a hannoveri CeBIT-en 2018. június 12-én. Fotó: Focke Strangmann / MTI / EPA)