Riadót fújtak a kutatók, a ChatGPT veszélyesebb, mint gondoltuk

További Gazdaság cikkek

-

Továbbra sincs telitalálat az ötös lottón, de 14-en így is milliomosok lettek

Továbbra sincs telitalálat az ötös lottón, de 14-en így is milliomosok lettek - A telefon- és internetszolgáltatások díjaiba is belenyúlhat a kormány

- Jó hír az elektromos autókat vásárló cégeknek, meghosszabbította a szaktárca a támogatási programot

- Mindenki örül az olcsóbb élelmiszernek, de nem lehetünk elég óvatosak

- Húszmilliárd forintos a vesztesége, feljelenti az államot a magyar milliárdos

A mesterséges intelligencia destruktív módon is felhasználható, ami új lehetőséget nyújt a kiberbűnözők számára – figyelmeztet jelentésében a Nemzeti Kibervédelmi Intézet (NKI). A jelentés szerint a ChatGPT naponta több ezer álhírt és közösségimédia-bejegyzést képes készíteni a rossz kezekben, ami azért probléma, mert az emberek gyakran feltétel nélkül elhiszik a futótűzként terjedő híreket.

Még nem most, de hamarosan tele lehet a programozók gatyája

A szövegtenyésztő program talán erősebb, mint gondoltuk.

A csetbotot széles körben használják az üzleti és az akadémiai szférában, és sokan úgy vélik, hogy a jövőben számos területen helyettesítheti az embereket.

De ez csak a jéghegy csúcsa. Az NKI a jelentésben arra is rámutat, hogy a ChatGPT a legkomolyabb bűncselekményekben segédkezhet az adathalászattól a pénzügyi csalásokig.

Olyan tudósok, mint Joy Buolamwini és Timnit Gebru, már egy ideje riadót fújtak a mesterséges intelligencia sötét oldala miatt. Safiya Umoja Noble sokat írt az algoritmusainkban rejlő elfogultságról, amely észrevehető az olyan népszerű alkalmazásokban, mint a TikTok, de a ChatGPT is érintett lehet. Olaszország adatvédelmi okokból azonnali hatállyal be is tiltotta a csetbotot.

Egy uniós ország úgy döntött, hogy betiltja a ChatGPT-t

Emellett 20 millió eurós pénzbírságot is kiszabhatnak a chatbot gyártójára.

Bűncselekményekre is rávehető

A kibervédelmi szervezet összegyűjtötte, hogy az élet mely területein használhatják ellenünk a programot, és hogyan védekezhetünk ezek ellen. A jelentés a következő kockázatokra hívja fel a figyelmet:

- Álhírek terjesztése: Az online dezinformáció és álhírek terjedése egyre nagyobb problémát jelent az utóbbi időben. Az emberek könnyen elhiszik a futótűzként terjedő híreket, ami súlyos következményekkel járhat. A ChatGPT és hasonló eszközök azonban tovább súlyosbíthatják ezt a helyzetet. A bűnözők ugyanis olyan szoftverekhez férhetnek hozzá, amellyel napi szinten több ezer álhírt és közösségimédia-bejegyzést generálhatnak.

- Spam: Egy valósnak tűnő, de valójában hamis weboldal vagy közösségi médiaprofil működtetéséhez rengeteg tartalomra van szükség. A kiberbűnözők azonban miért béreljenek tartalomgyártókat, vagy írjanak saját bejegyzéseket, ha ezt a ChatGPT segítségével kevesebb pénzből és időráfordítással is megtehetik?

- Adathalászat: Bár a spamszűrők hatékonyan szűrik ki a kéretlen leveleket, néhány adathalász e-mail továbbra is átcsúszhat rajtuk. Ha a megfelelő parancsokat adja meg valaki, akkor a ChatGPT is képes ilyen levelek generálására. Azonban ne várjuk el, hogy konkrétan egy adathalász e-mailt írjon nekünk, mert erre nem lesz hajlandó.

- Hamis weboldalak: Ha angolul rákeresünk a „ChatGPT website creation” kifejezésre a Google-ben, akkor rengeteg oktatóanyagot találunk, amelyek lépésről lépésre elmagyarázzák, hogyan készíthetünk weboldalt a ChatGPT segítségével. Ez nemcsak azoknak jelent jó hírt, akik a semmiből szeretnének weboldalt létrehozni, hanem a kiberbűnözők számára is. Ezzel ugyanis sokkal egyszerűbben és gyorsabban elkészítenek például egy hamis webáruházat.

- Malware-készítés: A ChatGPT olyan szoftver, ami tud kódolni, sőt, hibákat is tud javítani a kódban. Ez azt jelenti, hogy rosszindulatú programok írására is alkalmas, azonban egyelőre még a gyengébb vírusirtók is kiszűrik, hiszen ha nem egy tapasztalt programozó ellenőrzi a kódot, akkor benne maradhatnak olyan hibák és logikai hiányosságok, amelyek csökkentik azok hatékonyságát.

Legyünk résen

A jövőben az MI-alapú csetbotok továbbra is fejlődni fognak, és valószínűleg egyre inkább az életünk részévé válnak. A biztonsági és adatvédelmi kérdések megoldása azonban kulcsfontosságú ahhoz, hogy az emberek biztonságosan és megbízhatóan használhassák ezeket az alkalmazásokat. Az NKI a következő védekezési lépéseket tanácsolja:

- Biztonsági protokollok bevezetése: használjunk titkosítást, tűzfalakat és biztonságos jelszavakat az érzékeny információkhoz való illetéktelen hozzáférés megakadályozására!

- Tartsuk naprakészen a szoftvereinket és rendszereinket: a legújabb biztonsági javítások telepítése érdekében rendszeresen frissítsük a szoftvereket és rendszereket!

- Oktassuk az alkalmazottakat: tartsunk oktatást a social engineering és az adathalász támadások veszélyeiről, valamint arról, hogyan ismerjék fel és kerüljék el ezeket a támadásokat!

- Figyeljük a hálózati forgalmat: használjunk hálózatfigyelő eszközöket a szokatlan tevékenységek észlelésére, és reagáljunk azonnal!

- Használjunk MI-alapú biztonsági megoldásokat is: alkalmazzunk mesterségesintelligencia-alapú biztonsági megoldásokat, például fenyegetésérzékelő és -reagáló rendszereket (Threat Detection and Response – TDR) a támadások valós idejű azonosítása és megelőzése érdekében!

- Végezzünk rendszeres, biztonságra vonatkozó értékeléseket: rendszeresen értékeljük biztonsági helyzetünket, és kezeljük az esetlegesen feltárt sebezhetőségeket!

Rohamléptekkel tör előre az MI

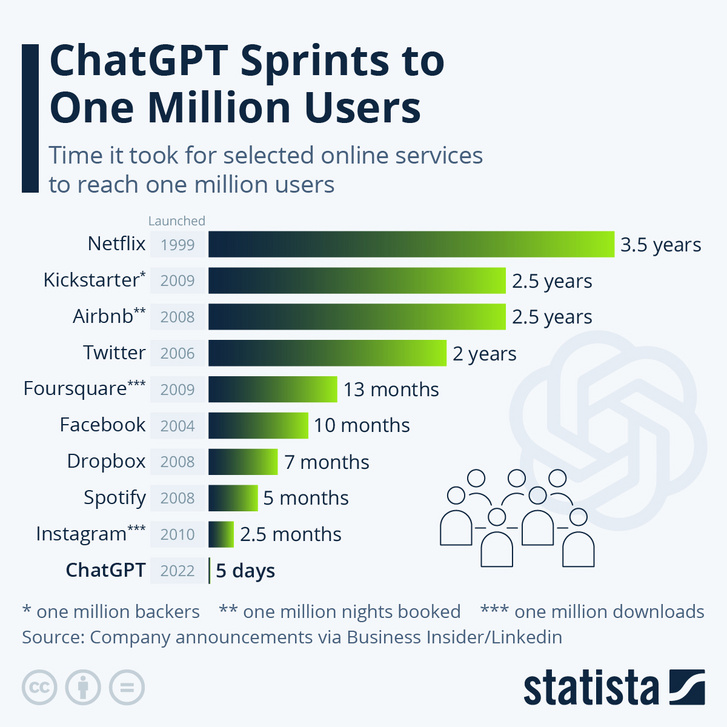

Tavaly november 30. óta nagyjából 200 millió ember használta már a ChatGPT-t, az egymillió felhasználó eléréséhez pedig mindössze öt napra volt szüksége a beszélő programot fejlesztő cégnek. Összehasonlításképpen: a Twitternek két évébe telt, mire elérte az egymillió felhasználót, A Facebooknak tíz hónap, a Dropboxnak hét hónap, a Spotifynak öt hónap, az Instagramnak pedig hat hét kellett.

A ChatGPT abban különbözik más nyelvi modellektől, hogy képes valós idejű reagálásra, hisz képes megérteni a beszélgetés kontextusát, és az alapján valós időben megfelelő válaszokat generálni. Ezt az önfigyelési mechanizmusok teszik lehetővé, mely segítségével a hálózat a bemeneti szövegben lévő különböző szavak és kifejezések fontosságát az adott feladat szempontjából mérlegelni tudja.

Azonban a ChatGPT mögött nem található tényleges tudás vagy logika.

Időnként a ChatGPT meggyőzően beszél ostobaságokról, akár nem létező tanulmányokra hivatkozva, ezért mindig kellő óvatossággal kell kezelni az általa generált tartalmakat.

Ennek ellenére még jelenlegi formájában is hasznos lehet például a kiberbiztonság területén is – írja az NKI.

Az adatvédelmi és biztonsági intézkedések betartása fontos, különösen akkor, ha a csetbotokat az életünk kritikus területein használjuk. Ellenkező esetben úgy járhatunk, mint amikor a napon felejtett fűnyíróba markolunk – csúnyán megégethetjük magunkat.

(Borítókép: David McNew / Getty Images)

Ehhez a cikkhez ajánljuk

- Gazdaság

Orbán Viktor olyat tett Donald Trumppal, amit előtte még senki

Meg is lett a jutalma.

március 25., 06:20

- Gazdaság

Varga Mihály kemény üzenetet küldött, Orbán Viktortól is kért egy fontos dolgot

Ez a hét legfontosabb hazai gazdasági történése.

március 25., 14:00

- Gazdaság

Ötszázezer forintra emelné az ingyenes készpénzfelvételt a Mi Hazánk

Novák Előd törvényjavaslatot is benyújtott az ügy érdekében.

március 25., 10:35

- Mindeközben

Egymásba szeretett a Megasztár énekesnője és a Hogyan tudnék élni nélküled? színésze

2 órája

- Mindeközben

Előkerült egy férfi, aki jobban hasonlít a Harry Potter sztárjára, Rupert Grintre, mint maga Rupert Grint

4 órája

- Gazdaság

Egyre durvábban eladósodnak a magyarok, meglepő okok állnak a háttérben

A személyi kölcsönöknél is érezni az inflációt.

március 25., 12:45

- Gazdaság

Továbbra sincs telitalálat az ötös lottón, de 14-en így is milliomosok lettek

A Luxornak ketten is örülhetnek.

53 perce

- Gazdaság

Ítéletet mondanak Magyarországról, a háttérben most már Varga Mihály mozgatja a szálakat

Történelmi pillanat következik.

március 25., 06:09

- Gazdaság

Megjelent a rendelet a bankautomatákról, 200 milliós büntetést kaphat, aki megszegi

Nagy Márton üzent a döntés után.

március 25., 07:21

- Gazdaság

Hűtlen kezelés miatt nyomoznak az MNB-alapítványok ügyében

Az Állami Számvevőszék feljelentése után ez a legfrissebb fejlemény.

március 25., 13:32

- Mindeközben

Emilión nevet a TikTok népe, aki hagyta, hogy a lánya megszépítse, minden az énekes arcára van írva

7 órája

- Címlapon

Robbanás Moszkvában: lángokban Vlagyimir Putyin limuzinja

Az orosz titkosszolgálat főhadiszállásánál történt az incidens.

4 órája

- Gazdaság

Elárulták, kik tartoznak Orbán Viktor középosztályába

Most ellenőrizheti, hogy középosztálybelinek számít-e.

március 25., 15:44

- Gazdaság

Varga Mihály váltott, új vezérigazgató a magyar tőzsde élén

Tóth Tibor május 1-től tölti be a pozíciót.

március 26., 09:23

- Mindeközben

Kiara Lord után egy másik versenyző is a Farm VIP feladását fontolgatja: „Lehet, hogy én is hazamegyek”

9 órája

- Címlapon

Az őrült ladás, a temetős robbantósok és az al-Kaida – merényletkísérletek, amiket túlélt Vlagyimir Putyin

Számtalanszor megpróbálták már likvidálni az orosz elnököt.

28 perce

- Címlapon

Százmilliós luxusautótól búcsúzhat Putyin flottája, mutatjuk, mit veszíthetett Oroszország vezetése

Rolls-Royce-külső, hibrid hajtás, éjjellátó rendszer – ilyen az orosz csúcslimuzin.

2 órája

- Gazdaság

Újabb ingyenpénzre lehet jelentkezni vidéken

5–30 millió forintos támogatást igényelhetnek a kkv-k.

március 24., 14:03

- Gazdaság

Az államtitkár szerint közel 900 élelmiszer ára csökkent az árrésstop bevezetése óta

Zsigó Róbert úgy véli, az áprilisi inflációs adatok igazolják majd az intézkedés bevezetését.

március 26., 09:42

- Gazdaság

Donald Trump emberének lefőhet a kávé, leidiótázták a nemzetbiztonsági tanácsadót

Bődületes szarvashibát követhetett el Mike Waltz.

március 25., 17:36

- Gazdaság

Érdemes sietni a tankolással, keddtől ismét jön a drágulás

A 95-ös benzin és a gázolaj ára is módosul.

március 24., 13:23

- Gazdaság

Megjelent az új rendelet az árrésstopról, egy hetük van a kereskedőknek cselekedni

Minden változásról tájékoztatniuk kell a boltoknak.

március 22., 09:48

- Mindeközben

Matt Damon nagy szakállal, Zendaya fehér ruhában látható az Odüsszeia forgatási fotóin

12 órája

- Mindeközben

Besurranó tolvaj lett egy kutyából, mire rájött a sintér, mit akar, bolondot csinált mindenkiből

14 órája

- Gazdaság

A Matolcsy-éra végnapjaiban lezavart cégátadási ügy kezd kiegyenesedni

Varga Mihályék léptek.

március 22., 11:37

- Gazdaság

Lecsapott a jegybank, nagy büntetést kapott a K&H Bank

Több hiányosság is előjött.

március 24., 11:44

- Gazdaság

Orbán Viktor előre megmondta, kinek a malmára hajtja a vizet Németország történelmi lépése

A miniszterelnök jóslata, úgy tűnik, kezd valóra válni.

március 23., 08:57

- Gazdaság

Mi van a füst mögött? A szabályozás és a tudomány csatája a dohányiparban

Kulcskérdés, hogy a káros hatások csökkentésére irányuló törekvések és a piaci szabályozások összhangba kerüljenek.

március 22., 19:21

- Gazdaság

Bedurrant a forint bicepsze, erősen kezdte a hetet a magyar fizetőeszköz

Maradt a múlt héten tapasztalt szint.

március 24., 07:21

- Címlapon

Bill Gates szerint ez a három szakma éli túl a mesterséges intelligenciát

Szerinte teljesen átalakulhat a gazdaság.

6 órája

- Mindeközben

Sydney Sweeney csobbant egyet a medencében, és ezzel robbantotta is a lájkbombát

tegnap, 22:00

- Mindeközben

Varga Viktor durva videóval jelentkezett be Baliról: „Halálközeli élményünk volt az óceán közepén”

tegnap, 21:22

- Címlapon

Figyelmeztetés érkezett Zelenszkijnek, veszélyesebb lehet a Putyin utáni világ Kijev számára, mint gondoljuk

16 órája

- Gazdaság

Kiderült, mikor juthatnak hozzá a pénzükhöz a nyugdíjasok áprilisban

Bankszámlára történő folyósítás esetén korábban kapják meg a járandóságukat.

március 24., 11:14

- Gazdaság

Beavatkozott a kormány, itt a fordulat az élelmiszereknél

Az árrésstop hatására egyes termékek ára 60 százalékkal is csökkent.

március 24., 10:41

- Gazdaság

Csaknem negyedmilliárd forintot értek ezek a számok a hatos lottón

Kihúzták a nyerőszámokat.

március 23., 16:58