Álhírek? Ugyan! A hamis képekkel kéne kezdeni valamit

További Tech-Tudomány cikkek

-

Rongyként nyújtható és csavarható az LG új kijelzője

Rongyként nyújtható és csavarható az LG új kijelzője - Az élet keresése közben végezhetett a marslakókkal az amerikai szonda

- Itt a nagy dobás a 4iG-től: műholdakat állítanak Föld körüli pályára

- Minden eddiginél furább hibrid szörnyeteggel rukkolhat elő az Apple

- Hamarosan képtelenek leszünk kiszolgálni az adatközpontok energiaigényét

Az erősen közhelyes mondás, miszerint egy kép többet ér ezer szónál, az álhírek esetében különösen igaz: az információs háború nehéztüzérségét a fotók és videók manipulációja jelenti.

Maga a képmanipuláció jelensége persze közel sem újdonság, legalább a 19. századig visszanyúló gyakorlatról van szó, de a hamis képek ma minden korábbinál élethűbbek, és minden korábbinál könnyebb létrehozni őket.

Persze a másik oldal se tétlenkedik: egyre több olyan cég jelenik meg, amely kifejezetten a hamis képek kiszúrására, illetve a hamisítatlan képek hitelesítésére összpontosít. Bemutatunk közülük néhányat.

Pics but it didn't happen

Egy évvel ezelőtt jelentek meg a deepfake videók, amelyekben pornójelenetekbe szerkesztették bele hírességek arcát mesterséges intelligencia (mélytanulás) segítségével. Ezt persze kellő szaktudással és hardverrel eddig is meg lehetett csinálni, ennyire egyszerűen viszont még sose. Tehát a deepfake azért szólt akkorát, mert kis túlzással demokratizálta a videómanipulációt, és a módszer nevét villámgyorsan kiterjesztették magára az általánosabb képhamisító trendre.

Azóta is folynak a fejlesztések, és szinte havonta érkezik hír újabb kísértetiesen élethű módszerről. Csak néhány példa:

- A Washingtoni Egyetem kutatói Barack Obama szájába adtak fiktív mondatokat.

- A Stanford Egyetemen fejlesztett szoftverrel pedig bárkinek a mimikája és szájmozgása valós időben szabható kedvünkre.

- A Berkeley-i Kaliforniai Egyetem kutatói bárkiről képesek olyan videót kreálni, mintha profi táncos lenne.

- A deepfake-eknek már saját – bár elég kezdetleges – Youtube-klónjuk is van, olyan gyöngyszemekkel, mint a Trumppal reppelő Putyin.

- És mellékszál ugyan, de mindeközben a hanghamisítás is egyre tökéletesedik.

A Photoshop korában a képek bizonyító erejébe vetett hit már amúgy is rég megingott, de ezek az új módszerek még tovább erodálják a képek iránti bizalmat, és ezzel az álhírek után új frontot nyitnak az információs háborúban. A deepfake videók ma még inkább a celebeknek okoznak fejfájást, de csak idő kérdése, hogy a politikát is elérje.

Csírájában elfojtani

A képmanipuláció térhódítása elleni küzdelembe egyre több cég száll be. A két legismertebb talán a Truepic és a Fourandsix Technologies, de ha az utóbbi nevét még nem hallotta, már ne is nagyon jegyezze meg, mert a Truepic december közepén felvásárolta. A két cég különböző megközelítéssel vette fel a harcot a képmanipuláció ellen: az egyik a kép készülését kontrollálná, a másik utólag szűrné ki a kamut.

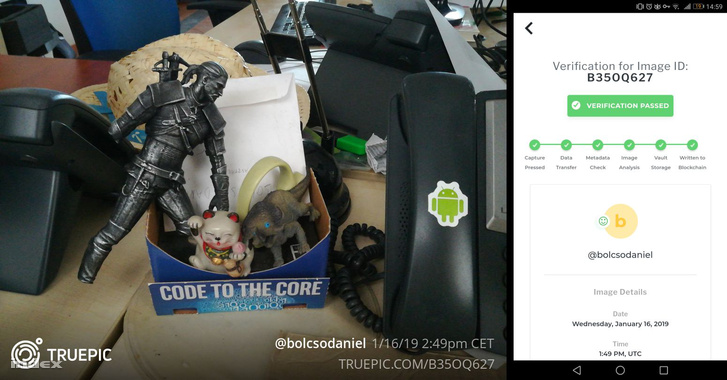

A Truepic csírájában igyekszik elfojtani a manipulációt azzal, hogy már a megszületésük pillanatában hitelesíti a fotókat és videókat, így bármilyen későbbi módosítás könnyedén kiszúrható. Ehhez telepíteni kell a cég kameraappját. Az ezzel készült képeket a Truepic technológiája elemzi, leveszi a digitális ujjlenyomatukat, és ellátja őket egy egyedi azonosítóval, amely alapján bárki ellenőrizheti az eredeti fotót. Ehhez a képeket a cég a szerverein is tárolja, illetve blokkláncra is fűzi, hogy visszakövethető legyen az eredetük, és senki ne tudjon babrálni velük. A módszerrel a felvételek eredete, tartalma és metaadatai (hol és mikor készültek) is könnyedén igazolhatók.

A Truepic szerint a technológia a legkülönfélébb helyzetekben jöhet jól, például

- biztosítási ügyekben, a kártérítési igénylésekhez csatolt fotók hitelesítésére;

- ha valaki feltölt egy apróhirdetést, és bizonyítani akarja, hogy az autója tényleg úgy néz ki, ahogy a csatolt képen;

- annak, aki Tinderen igazolni akarja, hogy valóban a saját képét használja;

- a médiának váratlan eseményekkor, a helyszíni olvasói fotók hitelességének ellenőrzésére;

- emberi jogi aktivistáknak, akik háborús bűnök hiteles dokumentálására használják, például Szíriában.

Az Androidra és iOS-re is letölthető app teljesen ingyenes, a cég abból remél bevételt, hogy pénzt kér más fejlesztőktől, hogy beépíthessék a saját appjukba a Truepic technológiáját. Az ugyanis irreális elvárás lenne, hogy tömegek kezdjenek el egy új – és fotós szempontból egyébként meglehetősen fapados – appal fotózni csak azért, hogy növekedjen a hiteles fotók aránya. Ahhoz, hogy a Truepic megoldása vagy bármilyen más hasonló technológia igazán nagy hatást érhessen el, széles körben el kellene terjednie, de ennek jóval reálisabb útja, ha a fotós és a közösségi – azaz a már amúgy is használt – appok fejlesztői beépítik magát a technológiát.

Ez viszont hosszabb távú projekt: Jeff McGregor, a Truepic vezérigazgatója szerint tíz év alatt juthatnak el idáig. Addig is kezdeni kell valamit azokkal a fotókkal, amelyek nem ilyen hitelesítéssel készültek – azaz a mai fotók nagyjából 99,99 százalékával. Itt jön a képbe az Fourandsix megszerzése.

Quand Elvis Presley 🕺 rencontre Kim Jong-Un #deepfakeshttps://t.co/DRugXquS7d pic.twitter.com/qaeIgJOjFi

— Al Kanz (@Alkanz) July 27, 2018

Kamuvadászat

A Fourandsix szolgáltatása, az Izitru nem a képek készítését felügyelte, hanem a már elkészült képekről állapította meg, hogy átestek-e módosításon. A cég technológiáját tavaly licencelte az amerikai védelmi minisztérium kutatási részlege, a DARPA a saját képhitelesítő programjához.

Az Izitru az alapján szúrta ki a manipulációt, hogy történt-e változás a kép metaadataiban (változott-e a tömörítés módja, rámentettek-e újra, stb) vagy magukban a pixelekben (vannak-e módosításra utaló nyomok, szabálytalan tükröződések, árnyékok, stb). Az ilyen digitális nyomelemzés persze nem újdonság (itt van például egy erre használható oldal), de az automatizálása és a bárkinek elérhetővé tétele nagyot dobhatna a hamisítványok kiszűrésén.

Az Izitru csak fotókat tudott kezelni, de a felvásárlás után a Truepic közölte, hogy szeretnék videókra is kiterjeszteni a technológiát. Jeff McGregor Truepic vezér már tavaly nyáron, a felvásárlás előtt is arról beszélt, hogy dolgoznak a képelemzésen, és azonosítottak olyan nyomelemző technikákat, amelyekkel kiszűrhetők a deepfake-ek és más hamisítványok. McGregor szerint olyan jellegzetességekre (például a haj, a fülek viselkedésére, a szem tükröződésére vagy éppen a pislogásra) érdemes figyelni, amelyeket még ma is közel lehetetlen élethűen utánozni egy videó több ezer képkockáján át – márpedig ebből a több ezerből elég párat elcsípni, hogy lebuktassanak egy-egy hamisítványt.

Válaszcsapás helyett megelőzés

A Truepichez hasonlóan a képek születésénél bábáskodó hitelesítőcég a Serelay. A két cég megközelítése közötti fő különbség, hogy a Truepic megőrzi az eredeti képet is, hogy az akkor is megtalálható és igazolható eredetű legyen, ha a készülékről törölni kell (például mert a készítője politikai okokból bajba kerülhet, ha megtalálják nála).

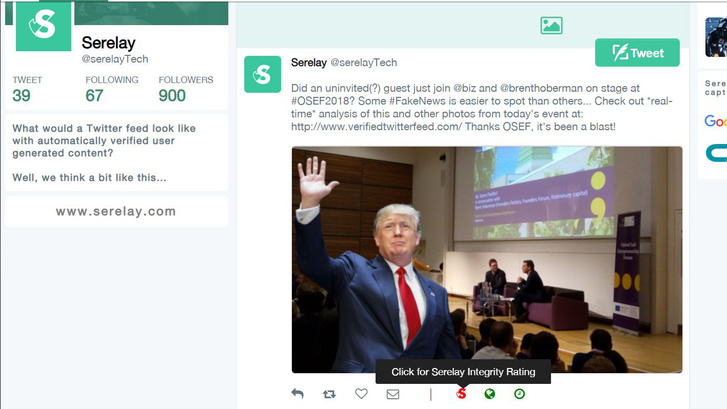

A Serelay viszont inkább a magánszféra és a személyes adatok védelmét helyezi előtérbe. Hozzájuk már el se jutnak a felhasználók képei, így azokat nem is tárolják, csak a belőlük generált, hitelesítéshez szükséges adatokat, amelyek alapján a konkrét kép nélkül is meg tudják mondani, hogy egy másolatán történt-e bármiféle módosítás. Nekik viszont nincs saját appjuk, csak kvázi viszonteladóként működnek, vagyis más cégek szoftverébe akarnak beépülni. Itt megnézhető egy demó a módszerükről.

Az Amber kifejezetten videók hitelesítésére összpontosít. Kétféle szolgáltatást kínál: a cég appjával készült videók eredetigazolását, illetve az ismeretlen forrásból származó videók hitelességének vizsgálatát. Az iPhone appjukat tüntetések, balesetek, vitás helyzetek rögzítésére ajánlják, hogy a vele készített videók hitelesített bizonyítékként szolgálhassanak.

Korábban részletesen írtunk arról, hogyan igyekeznek kisebb-nagyobb cégek mesterséges intelligenciával felvenni a harcot az álhírek ellen. Az Amber szerint ahelyett, hogy mesterséges intelligenciával próbálnánk fellépni a deepfake-ek ellen, és ezzel újfajta fegyverkezési versenybe bonyolódnánk, válaszcsapás helyett érdemesebb a megelőzésre koncentrálni, és ebben a kriptografikus hitelesítésre támaszkodni.

A böngészőkben működő hitelesítéshez hasonlítják a megoldásukat: ahogy a kis zöld ikon jelzi, hogy a meglátogatott oldal valóban az, aminek kiadja magát, ők a videóknál jelölnék, hogy eredeti vagy manipulált felvételt látunk-e. A Truepichez hasonlóan az Amber is a blokklánc segítségével követné a felvételek eredetét.

Visszanyerni a bizalmat

A deepfake-ek és a modern képmanipuláció elleni küzdelem még gyerekcipőben járnak. A cégek abban reménykednek, hogy ha egyszer a nagy techcégek is beépítik a megoldásukat, és mondjuk a Facebookra vagy az Instagramra automatikusan az általuk hitelesített képek kerülnének fel a mobilokról, szép lassan visszanyerhető volna az elmúlt években erősen megtépázott felhasználói bizalom, és vissza lehetne szorítani a manipulált képekkel operáló álhíreket.

A Serelay össze is dobott egy (fentebbi képen látható) fiktív Twitter-hírfolyamot, amelyen bemutatja, hogy nézne ki, ha beépülne a szolgáltatásuk: a képek alatt rögtön látszódna, hogy az elkészülte és a feltöltése között módosították-e magát a képet vagy a készítése helyét, idejét – mert hát szép dolog az utólagos tényellenőrzés, de mint tudjuk, a kamu gyorsabban és távolabb terjed, mint az igazság, ezért a (közel) valós idejű védekezés a siker kulcsa.

Nem csak a pixelek

De miközben a fent bemutatott próbálkozások főleg a képtartalom hitelesítésére összpontosítanak, a teljes képhez hozzátartozik, hogy nemcsak magának a képnek a manipulálásával torzítható annak jelentése: az érintetlenül hagyott kép kontextusának a módosításával is félre lehet vezetni. Csak néhány emlékezetes példa az utóbbi évekből:

- A 2011-es West Balkán-tragédiánál egy valódi, de hónapokkal korábbi kép alapján terjedt el a hamis pletyka, hogy késelés történt.

- A CEU-törvény elleni 2017-es tüntetésről készült képeket is lehet manipulatív módon felhasználni.

- A németországi menekülthelyzettel máshol, máskor és másról készült képek újracsomagolásával kiválóan lehet riogatni.

- Négy kép, amelyek mind a tavaly nyári G7 csúcstalálkozóról készültek, mégis más-más módon tálalják ugyanazt az eseményt.

- De a hondurasi kislány ikonikus képe is jól mutatja, hogy gyakran nincs éles határ: a fotó úgy vált a bevándorlócsaládok szétválasztásának szimbólumává, hogy noha magát a valóban létező problémát jól illusztrálja, a szereplőit valójában nem is választották szét.

Durván ferdíti a képi valóságot az állami propagandasajtó

Az Origo francia börtönőröket bújtatott német migránsbőrbe, hogy no-go zónákkal riogasson.

Mindebből jól látszik, hogy ha valaki igazi védelmet akar kiépíteni a képi dezinformáció ellen, a képkeretnél jóval tágabban kell gondolkodnia, és jóval nehezebb dolga lesz, mint ahogy az első ránézésre tűnhet.